长视频AI配音怎么做?批量生成和分段配音的高效方法

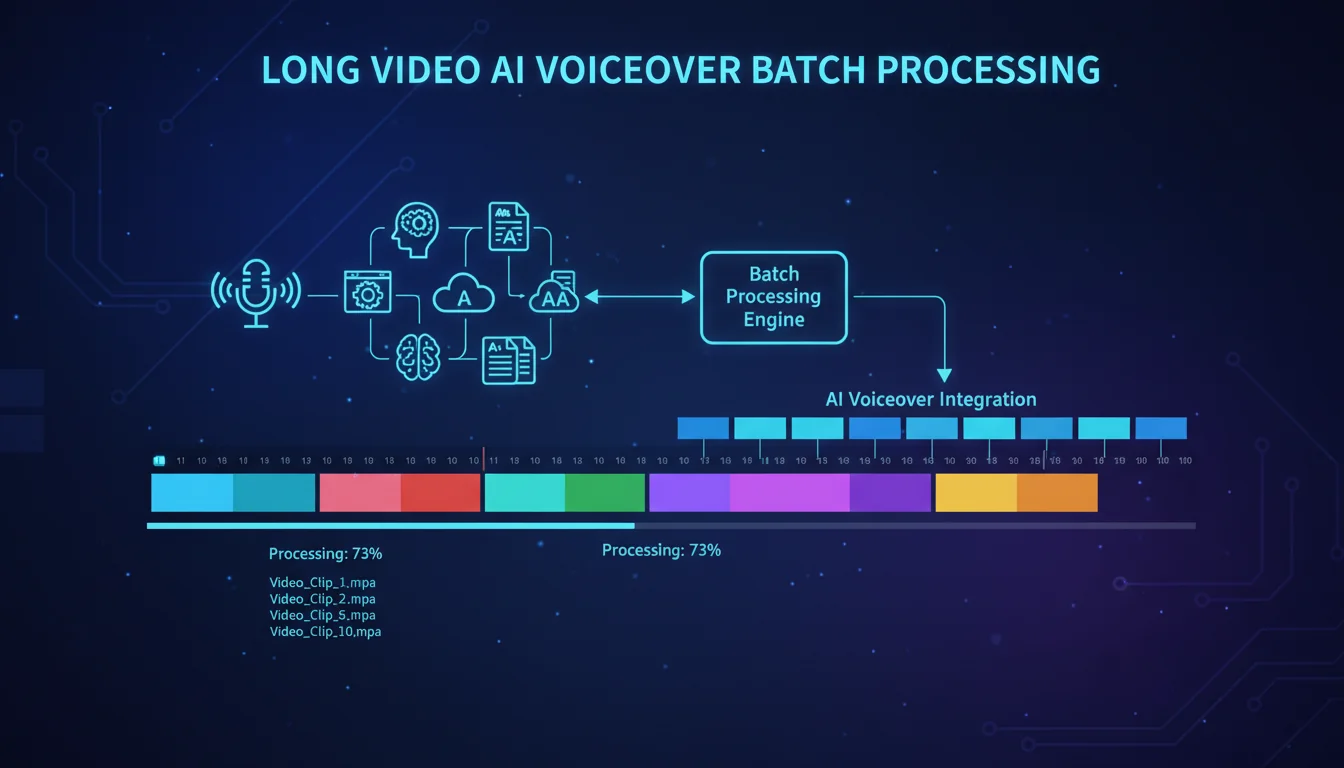

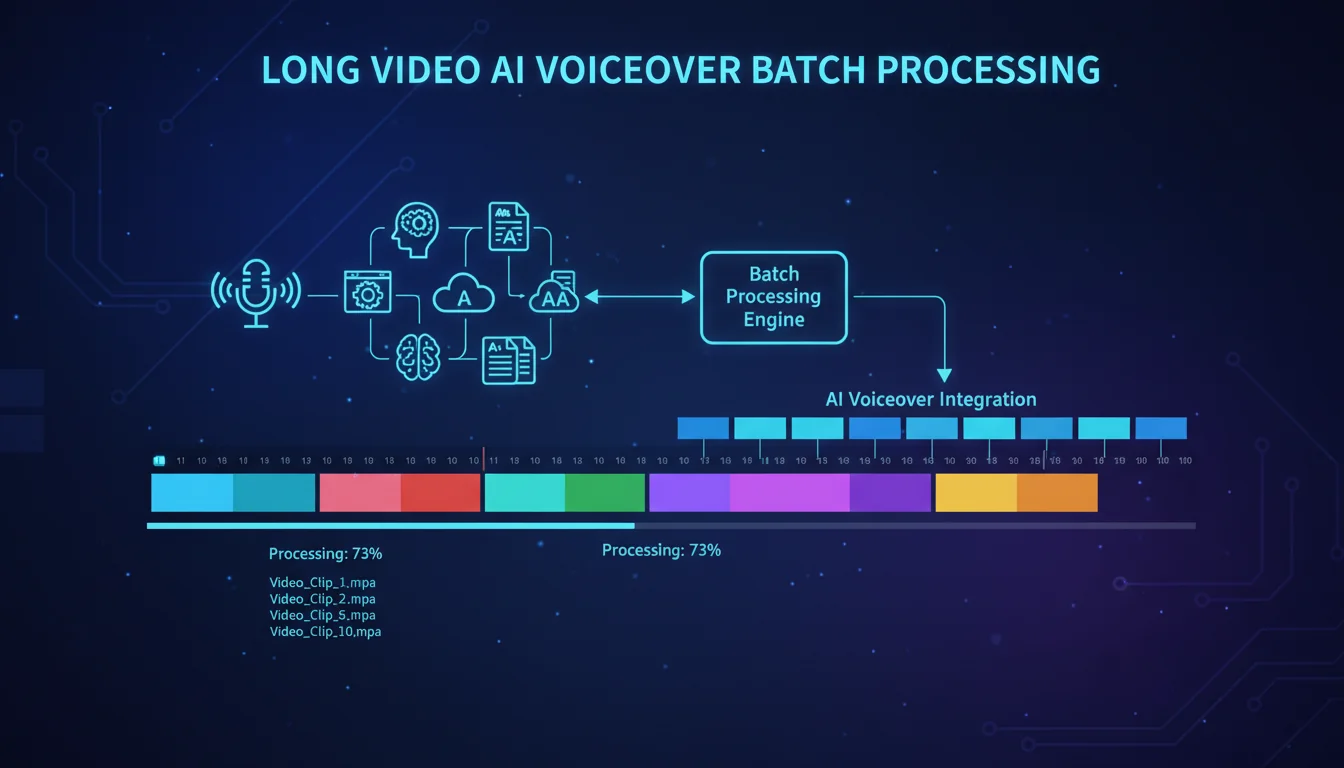

简单说:长视频AI配音的核心方法是"分段生成+批量处理"——把10分钟以上的文案按2-3分钟一段拆开,用API批量生成或逐段生成,然后在剪辑软件里拼接对齐。比一整段生成音质更稳、效率更高。

长视频AI配音怎么做?批量生成和分段配音的高效方法

去年我接了个活,给一个15集的纪录片做配音,每集20分钟。按我以前的套路,就是一段一段手动生成,然后一段一段拖进PR里对时间轴。结果第一集做下来花了我6个小时,光对时间轴就对了一下午。

做到第三集的时候我受不了了,花了一个下午研究批量生成的方法,把20分钟的视频拆成8段,用API并发处理,生成时间从30分钟压缩到3分钟。再加上分段拼接的标准化流程,每集的配音时间从6小时降到了1.5小时。这才是长视频ai配音该有的效率。

这篇就把我摸索出来的长视频配音方案全部整理出来,从分段策略到批量API到拼接技巧,一网打尽。

长视频配音为什么要分段?

长视频必须分段配音的原因有三个:单次生成字数上限、音质稳定性、修改效率。分段后每段独立,改一段不用全部重做,音质也更稳定不会出现尾部失真。

主流AI配音工具都有单次生成上限。这个上限不是工具故意卡你,是技术限制——太长的文本一次性合成,模型到后半段容易"疲劳",语调变平、节奏乱掉。

| 工具 | 单次上限(字数) | 对应时长 | 超长文本表现 |

|---|---|---|---|

| 剪映 | 约5000字 | 8-12分钟 | 超3000字后语调明显变平 |

| Azure TTS | 约10000字 | 15-25分钟 | 稳定性好,但偶有节奏问题 |

| ElevenLabs | 约5000字 | 8-15分钟 | 英文稳定,中文偶有断句错误 |

| 讯飞配音 | 约8000字 | 12-20分钟 | 中文最稳,语调一致性高 |

我实测的结果是:不管哪个工具,控制在2-3分钟一段(约500-800字),音质和语调的一致性最好。超出这个范围,尾部10%-15%的内容质量会明显下降。根据IDC2025年的报告,企业级AI语音合成项目中有78%采用分段处理策略。

长视频分段配音的具体操作方法

长视频分段配音分四步:按2-3分钟拆分文案→每段统一音色和参数→逐段或批量生成→在剪辑软件中拼接对齐。

拆分文案是第一步,也是最关键的一步。拆分的原则是:按语义完整段落拆,不要在一句话中间断开。比如你有一段3分钟的解说词,讲到"这个问题的原因有三个"的时候,不要在这里断,把"三个原因"都讲完再断。

拆分完成后,所有段落的参数必须统一:同一种音色、同一个语速、同一个音调。这一点非常重要。参数不统一的话,拼在一起听的时候每段之间会有明显跳变,听起来像换了个人在说话。

生成阶段有两条路:

路一:手动逐段生成。适合不写代码的人。打开AI配音工具,一段一段粘贴文案、生成、下载。虽然操作重复,但每段都能单独检查,质量可控。用FlowPix的批量模式可以省掉反复粘贴的步骤,把所有段落排好队自动生成。

路二:API批量调用。适合懂一点编程的人。写个Python脚本,把文案列表丢进去,循环调用API并发处理。10段文案2分钟全部生成完毕,下载好排序好的音频文件。具体代码我放在下面:

批量调用示例(以Azure TTS为例):

import azure.cognitiveservices.speech as speechsdk

segments = ["第一段文案...", "第二段文案...", "第三段文案..."]

for i, text in enumerate(segments):

# 配置语音合成参数

synthesizer = speechsdk.SpeechSynthesizer(config)

result = synthesizer.speak_text_async(text).get()

# 保存为音频文件

with open(f"segment_{i:03d}.wav", "wb") as f:

f.write(result.audio_data)

更详细的API调用方法可以看AI文字转语音教程。

分段配音拼接的接缝处理

分段配音拼接的接缝处理三个关键操作:每段首尾各留0.5秒空白、拼接点加0.3秒交叉淡化、统一所有段落的音量到同一标准(-16LUFS)。

接缝问题是我踩过最大的坑。早期我做的纪录片,每段之间能听到明显的"咔哒"声,像换唱片一样。后来找到了解决方案,其实就三招:

第一招:留空白。每段文案生成的时候,开头和结尾各多加一个句号。AI会在句号处自然停顿0.3-0.5秒,给你后续裁切和过渡留出余量。

第二招:交叉淡化。在剪辑软件里,两段音频重叠0.3秒,前一段淡出、后一段淡入。剪映里右键音频条→"音频淡化",PR里拖音频边缘自动出现交叉淡化手柄。这个技巧在AI配音和剪辑工作流那篇也详细讲过。

第三招:统一音量。AI配音不同段落的音量可能有微小差异,人耳听单段不觉得,拼在一起就能听出来。在PR里用"响度"效果器把所有段落统一到-16LUFS,剪映里用"音量"功能手动微调。这个步骤很枯燥但是很必要。我那个纪录片项目,光是统一音量就花了一个小时,但效果提升非常明显。

如果你是批量处理的话,推荐用Audacity的批量标准化功能,可以一次性把所有音频文件的音量统一到同一水平,比在剪辑软件里逐段调整快得多。

常见问题

长视频AI配音一次能生成多长的?

大多数AI配音工具单次生成上限在5000-10000字之间,约5-15分钟的音频。超过上限的文案需要分段处理。建议每段控制在2-3分钟(约500-800字),分段生成后再拼接,音质更稳定。

长视频AI配音怎么批量生成?

两种方法:一是用API写脚本批量调用(适合技术人员),二是用剪映/Azure等工具分段逐个生成(适合所有人)。API方式速度快,10段文案可以并发处理,2分钟全部搞定。手动分段生成慢一些,但操作更直观。

长视频分段配音后拼接有接缝怎么办?

接缝问题有三个解决办法:每段结尾和开头各留0.5秒空白做过渡、在拼接点加0.3秒交叉淡化、统一所有段落的音量和音调参数。剪映的音频交叉淡化在音频条右键菜单里,PR用恒定功率交叉淡化效果。

觉得有用的话分享给朋友吧。